Funktionsweise des Autofokus: Teil 2

German (Deutsch) translation by Max Benjamin (you can also view the original English article)

[latex]Nach unseren ersten Blick in den Autofokus, nehmen wir nun einen eher technischen Ansatz. Ich bin fest der überzeugung, dass je mehr Sie verstehen, über Ihre Kamera und wie Sie interpretiert die Welt aus technischer Sicht, desto mehr können Sie erhalten, genau zu erstellen Sie Ihre vision.

Die Schnelle Technische Geschichte

Leitz, jetzt bekannt als Leica, begann der Patentierung einer Serie von Autofokus-system-Technologien im Jahr 1960, und zeigte eine Autofokus-Kamera auf der Photokina (seit 1950) 1976. Das erste in Serie produzierte AF Kamera war die Konica C35-point-and-shoot-veröffentlicht im Jahre 1977. Die erste AF 35mm SLR war die Pentax ME-F im Jahr 1981, gefolgt von einem ähnlichen Nikon F3AF 1983.

Ursprünglich sind alle diese frühen AF-SLRs hatte, Linse, Motoren, im wesentlichen ein standard-Objektiv mit einem dicken motor block geklebt. Dies dauerte bis zum Jahr 1985 Minolta Maxxum 7000 hatte der Antriebsmotor in der Kamera zusammen mit den sensoren.

Dies war die erste AF-SLR, traf sich mit vernünftigen kommerziellen Erfolg. Die bisherigen versuche waren langsam, innaccurate und funktioniert nur unter idealen Bedingungen, die nicht wirklich ein Fall für den doppelten Preis im Vergleich zu ähnlichen manuellen Fokus-Kameras. Die Maxxum 7000 Kosten-Minolta 130 Millionen US-Dollar im Jahr 1991 nach einem langwierigen patent-Schlacht mit der US-Firma Honeywell über die AF-Technologie.

Nikon folgte Minolta-Anzug, aber wieder auf Objektiv-Motoren im Jahr 1992, also moderne Einsteiger-Nikons nicht, die einen integrierten AF motor. Canon EOS (electro-optical-system), AF-system kam im Jahr 1987, wo Sie verärgert viele Fotografen, indem er die FD Objektiv-mount-und die Schaffung der vollständig elektronischen EF-Bajonett.

Gut, das ist in der Regel, was passiert ist und die Reihenfolge, in der es passiert ist. Also, was über die Technik selbst? Lassen Sie Graben ein wenig mehr.

Physikalische Implementierungen

Phase-Erkennung

Phase erkennen Autofokus der schnelle AF gefunden auf DSLRs (und zunehmend auch spiegellose Kameras als Teil eines hybrid-AF-system). In DSLRs, Teil des Hauptspiegels ist semi-versilbert und geht über ein Viertel der Licht von der Linse auf einen kleinen Fangspiegel, die dahinter steht und unten in der Basis der Spiegel-box. In der base sind kleine Linsen bündeln das Licht von den Kanten der Linse auf den CCD-sensor-array.

Das array ist in der Regel aus einer Reihe von eindimensionalen Streifen von Pixeln in verschiedenen Ausrichtungen. Jeder Streifen kann man nur eine Funktion, die Kontraste senkrecht, als die einzige Veränderung, die es sehen kann, ist entlang der Linie. Wenn ein Merkmal in dem Bild ist parallel zum strip, es kann nur sehen, einen bestimmten Aspekt der Funktion auf einmal, anstatt die "Form" der.

Kontrast-Erkennung

Kontrast-Erkennung in der Regel vorhanden ist, die direkt auf dem Bildsensor selbst, daher seine Verwendung in der live view bei DSLR-Kameras. Es ist in der Regel die einzige detection system auf spiegellose und kompakte Kameras. Es ist eine software-Implementierung, so gibt es keine mehr Reale physische Aspekt, um es, nur den sensor und einen Prozessor.

Hybrid-Detection

Wie der name schon sagt, eine Kombination beider Systeme. Dies kann die form der Umwandlung einige der sensor-Pixel-AF-Pixel, oder eine phase haben, erkennen, array-geschichteten über den sensor, der arbeitet dann mit dem Kontrast erkennen system im tandem-Betrieb zur Verbesserung der AF-Geschwindigkeit.

Wie Die Dinge Funktionieren

Ok, jetzt wissen wir die physische Konfiguration für jeden Typ AF-system, lassen Sie die Abdeckung wie Sie Ihre jeweiligen Implementierungen um Ihre Arbeit zu tun.

Fokus Und Entfernung

Die zusammengesetzte Linse (optisches system aus einer Reihe von einfachen Linsen, in der Regel als "Elemente" in der Fotografie Literatur) - system in Ihre Kamera-Objektiv verwendet eine oder mehrere bewegliche Linsen, die zur Fokussierung der Lichtstrahlen in der Bildebene.

Der Abstand zum Motiv bestimmt, wie weit die Korrektur-Linse bewegen muss, um zu fokussieren. Betrachten Sie es wie eine Brille für die Haupt-Optik, nur das anstelle des änderns der Linse macht, ist seine position geändert.

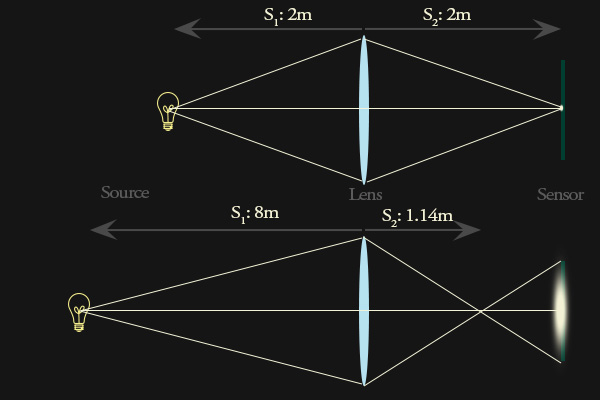

Nehmen wir ein einfaches Beispiel mit nur einer einfachen Linse, um zu zeigen, wie sich das Motiv bewegt, wird das Bild weichgezeichnet wird, angenähert durch den dünnen Linse die Formel:

$${1 \over f} = {1 \over S_1} + {1 \over S_2}$$

Diese Gleichung wird davon ausgegangen Objektive von vernachlässigbarer Dicke, in der Luft, so dass es nicht genau übersetzen, um real-world-Objektive, aber es erlaubt mir, um die Stelle auf mehr einfach.

Wir verwenden eine Punkt-Lichtquelle mit einer Linse der Brennweite 1m (1000mm). Dies gibt ein \(1 \over f\) den Wert 1 zu. Wenn \(S_1\) beträgt zwei Meter, \(1 \over S_1\) ist 0.5. Damit \(S_2\) ist auch 2m, wenn das Objektiv fokussiert ist. Wenn wir uns bewegen, die point-source-Thema zurück zu 8m entfernt von der Linse, \(1 \over S_1\) zu 1/8. Um das zu kompensieren, \(1 \over S_2\) werden muss, 7\8, die eine \(S_2\) - Wert von 8/7, oder 1.14 m. Natürlich, der \(S_2\) - Wert behoben wird, da der sensor stationär ist, so dass das Bild geworfen wird, aus dem Fokus.

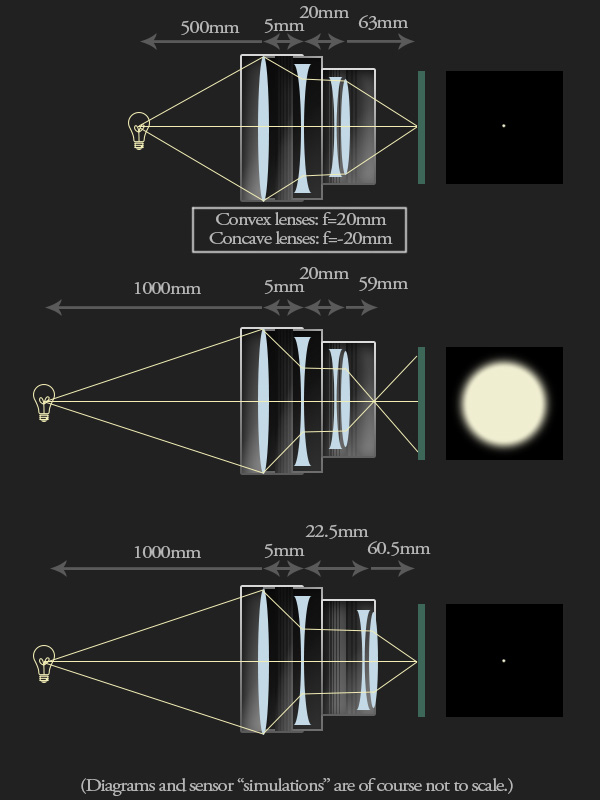

Wenn wir legen eine zweite, korrigierende, Objektiv im Abstand \(d\) aus dem ersten in dieses optische system zum erstellen eines zusammengesetzten Linse, können wir uns das Bild, wie sich das Motiv bewegt. Die kombinierte neue Brennweite ist, nach dem compound-dünne Linse-Gleichung:

$${1 \over f} = {1 \over f_1} + {1 \over f_2} - {d \over f_1 f_2}$$

So haben wir eine neue Brennweite. Der Abstand von der neuen Linse, um die neue Anlaufstelle für das kombinierte system wird als schnittweite, was sollte ein relativ bekannter Begriff in der Fotografie, denn es ist der Abstand von der hinteren element des Sensors. Wenn ich call back focal length "\(d_2\)", diese ist gegeben durch:

$$d_2 = {{f_2 (d - f_1)} \over {d - (f_1 + f_2)}}$$

Nehmen wir ein Beispiel, wo das Bild ist konzentriert auf einer festen Bildebene, dann das Motiv bewegt. Hinzufügen divergierenden Korrekturgläsern und Knirschen der zahlen gibt uns dies:

Die Mathematik kann nicht makellos sein, aber es ist gut genug, um die Nummer auf! So wie sich das Motiv bewegt, die Korrektur-Linse bewegen muss, um zu kompensieren, da die imaging-Ebene fixiert ist.

In die AF-Systeme, die Elektronik berechnet, wo das Objektiv bewegen muss, und weist die Objektiv-motor, um es zu bewegen gibt. Wie tut es dies? Dies bringt uns zu-detection-Systeme.

Phase Erkennen

Die kleinen Linsen in der Basis der Spiegel-box konzentrieren das Licht von den gegenüberliegenden Seiten der Linse. Da der Abstand zwischen diesen beiden Punkten, eine Parallaxe erstellt, wo jeder sieht etwas anderen Blick auf das Thema, ebenso wie die beiden input-Linsen in einer Messsucher-Kamera.

Die einzelnen Punkte sind im Fokus, genau wie in einem Entfernungsmesser; es ist die unendliche Kombination der Punkte in die zwei-dimensionale Bild-Feld schafft, dass die Brennweite die Unschärfe in ein Bild. Dies ist der Grund, warum große öffnungen schaffen, mehr verschwommen, nicht durch irgendeine Art von optischen manipulation, sondern einfach, weil mehr der Durchmesser des Glases verwendet wird, die Schaffung von mehr Punkte zu überlappen, und erstellen Sie die Unschärfe. Stellen Sie sich AF sein mit einer f/22 oder kleinere Blende auf jeder Seite der Linse, so dass der Blick bleibt im Fokus-unabhängig von der Objektiv-Brennweite position.

Während das Licht kommt von den gegenüberliegenden Seiten der Linse, die split-Bild gehen, um die AF-sensoren ist der gleiche Teil des Objekts, wo der AF-Punkte im Sucher sind.

Die CCD-Streifen ausgelesen und an einen dedizierten AF-chip, der führt einen Vergleich zwischen den beiden. Während einzelne Hersteller, die Verbesserung der Technologie, die zum patent infringment-Vermeidung und verschiedene Preis Punkte der Ausrüstung wahrscheinlich alter der genaue Algorithmus verwendet, der Allgemeine Punkt hier ist, führen Sie eine mathematische Funktion, die aufgerufen wird, eine Autokorrelation, oder ähnliches.

Autokorrelation ist ein pattern-matching-Algorithmus unter dem Dach der Kreuz-Korrelation in der Signalverarbeitung, sondern vergleichen zwei unterschiedliche Signale, es vergleicht ein signal mit einer verschobenen version von sich selbst. Im wesentlichen ist es eine integral - (oder eher in diesem Fall von diskreten Wert legt, Summe) Funktion, die berechnet, vergleicht und maximiert die Fläche unter dem signal überlagert Grafiken.

Das Ziel ist, zu berechnen, wie weit es ist, um eine Verschiebung der Signale um zu maximieren, und somit passen die zwei Ansichten. Die Mathematik ist sehr langatmig (es würde wahrscheinlich nehmen Sie einige Artikel, die Arbeit durch ein basic-Beispiel), aber das Ergebnis der gesamten final-Algorithmus fallen sollte zwischen 1 und -1, mit der Kamera zu finden suchen Sie die shift-Wert, bei dem der Wert der Korrelation ist so nahe an 1 wie möglich.

Indem es dies tut, es sieht und versteht die gleiche Funktion aus jeder Seite der Linse, und die Kenntnis der physikalischen räumliche Verschiebung zwischen Ihnen entlang der pixel-Streifen erzählt, mit der Trigonometrie auf der Grundlage der bekannten Abmessungen Kamera, wie weit und in welche Richtung das Objektiv ist unscharf. Es können dann senden Sie ein af-signal auf die Linse, und überprüfen Sie den Fokus nach dem Umzug. Das ist, wenn Sie Ihre Kamera zeigt Fokus-lock und kann das Bild gedreht werden.

Sie haben vielleicht gehört, dass der "Punkt" oder "Punkt" AF-Punkte vs. "cross" Typ AF-Punkte. Der Unterschied zwischen denen ist, die Punkt-Art Punkte sind die einzigen, eindimensionalen Streifen von Pixeln, in der Erwägung, dass Kreuzsensoren sind zwei Linien, die senkrecht angeordnet. Da ein AF-sensor ist ein-dimensional, es sehen nur die Leuchtdichte verändert sich entlang seiner Länge. Dot-Art-sensoren sind somit nur empfindlich zum detail in eine Richtung, in der Erwägung, dass cross-Typen sehen kann, in zwei Dimensionen.

Wenn ein Punkt-sensor ist parallel mit einem wichtigen detail, feature, es kann nicht sehen, den Unterschied zwischen ihm und dem benachbarten, kontrastierende Funktion, und hat somit erhebliche Schwierigkeiten bei der Fokussierung.

Kontrast Erkennen

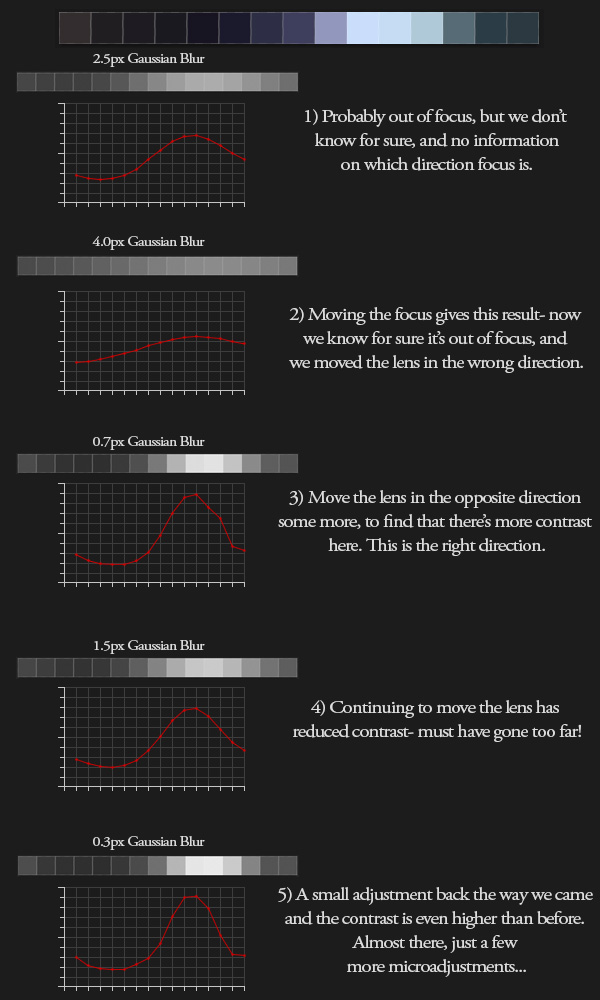

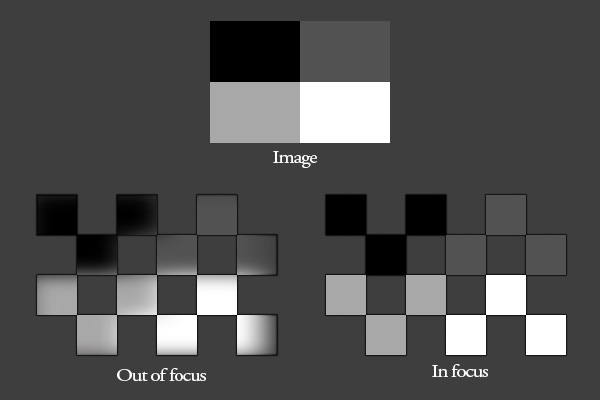

Diese Methode liest aus ein paar Pixel in die gewünschte position the imaging sensor. Der Prozessor berechnet den Kontrast zwischen dieser Pixel, der Unterschied in der Leuchtdichte über die pixel Abstand gemessen wird. Durch die Berechnung der Steigung der Kurve entlang der pixel-Zeilen und Spalten, Sie können versuchen, zu maximieren den Wert dieser Steigung.

Der Fokus ist dann geringfügig verschoben, und der Kontrast ist erneut berechnet. Wenn der Kontrast niedriger ist, hat das system bewegt das Objektiv in die falsche Richtung, so dass es dann in die Gegenrichtung. Der Kontrast ist nochmals gemessen, ist das Objektiv sich weiter, und dieser Prozess wiederholt sich während der Kontrast-Wert steigt, bis es eintaucht. Wenn es fällt, das Objektiv zu weit gegangen wurde, und der Algorithmus bewegt sich die Linse wieder zurück, wodurch sich eine weitere microadjustments.

Die Kontrast-detect-Methode von AF hat das Potenzial, sehr genau sein, weil es auf der sensor-Ebene keine separaten system. Nur es bewegt sich das Objektiv, bis der Kontrast maximiert wird. Leider aus dem gleichen Grund scheint es unwahrscheinlich, dass jemals schnell sein; Sie könnte argumentieren, dass es sollte nur eine Messung an zwei Themenschwerpunkte Positionen, um zu wissen, wie viel das Objektiv defokussiert ist, aber erfordert, dass die Kamera genau zu wissen, wie kontrastreich das Motiv ist zu beginnen.

Es hat keine Möglichkeit zu wissen, was der "wahre" Verteilung der Leuchtdichte-Werte gemessen werden, denn Sie sind abhängig vom Thema. Deshalb ist es auch nicht eine "Schwelle gradient" noch eine "ideale peak luma Wert." Diese Dinge variieren stark von Szene zu Szene.

Damit, für die absehbare Zukunft, professionelle Filmemachen weiterhin verwenden der manuellen Fokus-Puller, wie es immer hat, und spiegellose Punkt-und-schießt weiterhin zu langsam sein. Es sei denn...

Hybrid-Systeme

Was, wenn Sie bekommen konnte das beste aus beiden Welten? Was wäre, wenn Sie die Geschwindigkeit von phase-erkennen und beseitigen der Jagd, sondern kombinieren diese mit der Genauigkeit und der Einfachheit der Kontrast-Erkennung? Gut, das ist genau das, was die Hersteller jetzt tun.

Anstatt die phase-Erkennung-Streifen auf der Unterseite des Spiegel-box, die ist nutzlos, spiegellose Kameras und DSLRs im live-view -, Sie sind vielmehr geschaffen, die als dedizierte arrays auf dem Bildsensor selbst. Aber sicherlich gibt es nichts zu phase-match auf dem sensor, weil es immer gestrahlt von allen das Licht vom rest der Linse in einem großen verschwommenen Kreis der Verwirrung, wie ich schon früher gesagt? Nicht so schnell!

Denn die Pixel (technisch "sensels," da Sie in der sensor-Elemente und nicht-Bild-Elemente) auf einem imaging-sensor abgedeckt werden Mikrolinsen für eine verbesserte Licht-sammeln, alles, was wir tun müssen, ist block off Hälfte der pixel um das Bild von einer Seite der Linse. Ist das ideal? Nein, das Bild immer noch unscharf, aber halb so verschwommen, wie es ist, wenn man das ganze Objektiv, und jetzt können wir es verwenden, um genauer erkennen zu konzentrieren, weil es eine Parallaxe zwischen den beiden Bildern.

In der Fuji X100s diese Technologie wird verwendet, um Rindfleisch-up, der die manuelle Fokussierung visual aids mit einem split-PRISMA-wie EVF-overlay, aber Sony verwendet es als eine echte hybrid-system in Verbindung mit Kontrast-detect AF als "Fast Hybrid AF" in Ihrer High-end-NEX-Kameras. Canon und Nikon, auch dieses Konzept in Ihre Low-end-Kameras. In der Sony A99, eine zweite dedizierte phase detection array nutzt die translucent mirror, indem Sie überlagert sich direkt vor dem Bildsensor, bekannt als Dual-AF.

So on-sensor phase detection low-light-Fähigkeit, nicht bis zu viel, es neigt dazu, begrenzt zu werden zu einem Mittelpunkt reduzieren die Anzahl der Pixel, die aus der Bildgebung zu verwenden, und die Technologie noch in Ihren Kinderschuhen steckt. Aber mit mehr dedizierte Systeme wie Sony das Duale AF-arrays, und vielleicht einige "geopfert" - Bild-sensor Pixel (mit software-interpolation) mit mehr direktionale Mikrolinsen, das sieht aus wie die Zukunft der Autofokus.

Fazit

So haben wir von der Erfindung des Autofokus, über die Entwicklung und die weit verbreitete Annahme. Wir haben uns angeschaut die grundlegende optische mechanik konzentrieren. Wir wissen, welche Arten von AF gibt es, wo Sie in die Kamera, und wie Sie funktionieren, und wie diese Attribute praktisch Einfluss auf die Leistung der Kamera. Wir haben einen Blick auf die jüngsten Entwicklungen in der hybrid-Autofokus-Systeme, und überlegten, wo Sie weiterhin von hier aus.

Wenn mit AF, überlegen Sie, wie die Kamera zu sehen und die Szene entsprechend anpassen. Beim Einkauf für Kameras, nehmen Sie einen guten Blick auf Ihre AF-Systeme sind und wie gut Sie arbeiten können, die für Ihren Stil der Dreharbeiten.

Gut, das ist ein wrap auf diesem technischen überblick über Autofokus. Fragen? Kommentare? Schlagen bis die Kommentare unten!